Indice

- Introduzione

- Chi è davvero coinvolto dall'AI Act (e chi pensa di non esserlo)

- Le categorie di rischio: come capire in quale rientri

- Gli obblighi concreti per una PMI italiana

- Cosa fare nei prossimi 4 mesi: un piano realistico

- Gli errori da evitare nella corsa alla compliance

- Conclusione

Introduzione

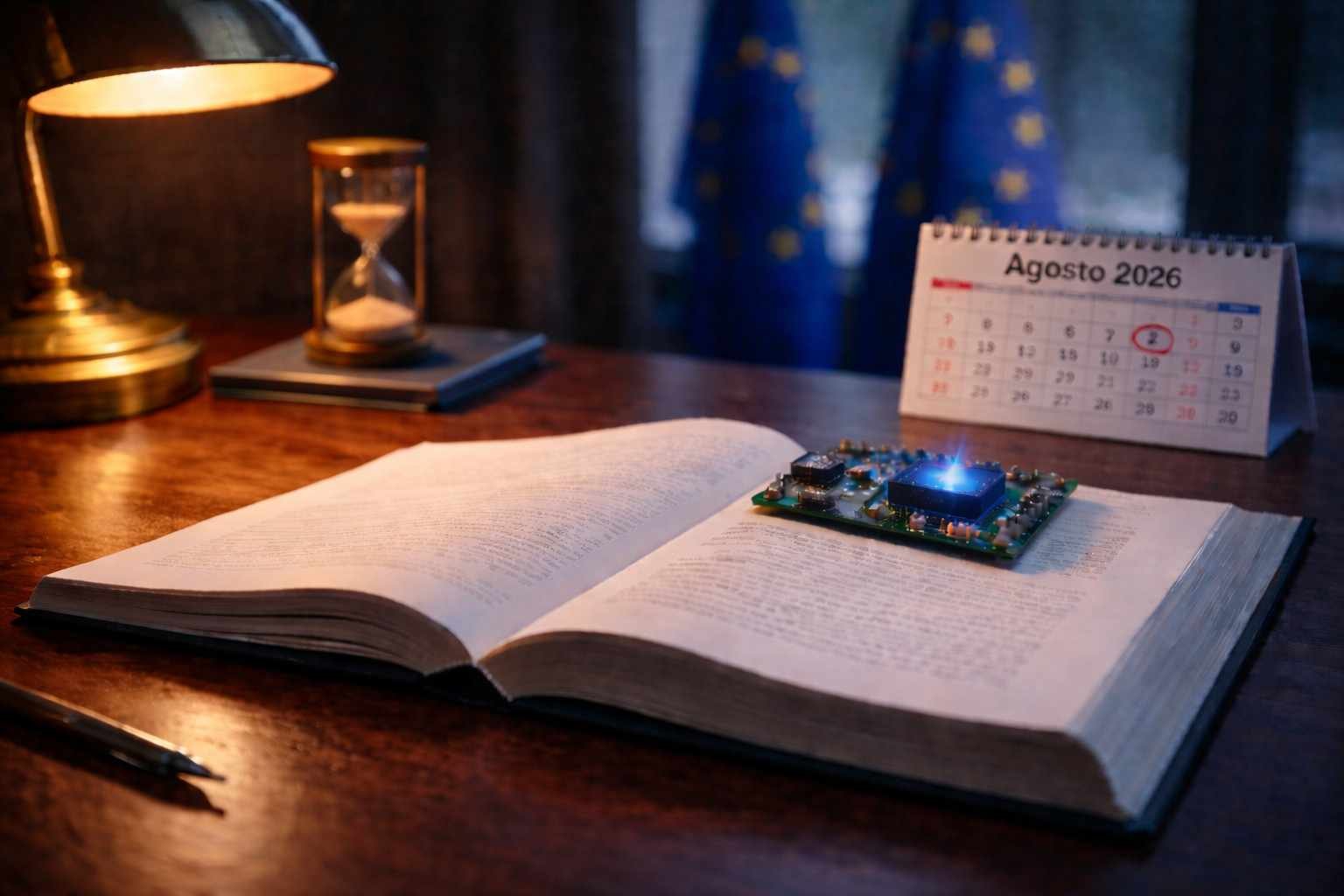

La piena applicazione dell'AI Act, il Regolamento europeo sull'intelligenza artificiale, è fissata per il 2 agosto 2026. Per chi legge questo articolo a marzo, significa che rimangono circa cinque mesi per arrivare pronti. Non sono molti, ma non sono nemmeno pochi se si parte ora con un piano ragionato. Sono decisamente pochi se si aspetta ancora luglio per iniziare.

La maggioranza delle PMI italiane non ha ancora affrontato seriamente il tema. In parte perché il regolamento è percepito come distante, in parte perché si pensa che "riguardi solo le big tech". Nessuna delle due letture è corretta. L'AI Act è un regolamento orizzontale che riguarda chiunque usi sistemi di intelligenza artificiale, anche quelli comprati già pronti, anche quelli integrati in altri software. Questo articolo prova a trasformare la materia da ostacolo burocratico a lista di cose concrete da fare.

Chi è davvero coinvolto dall'AI Act (e chi pensa di non esserlo)

Il primo errore è pensare di non essere coinvolti. Il regolamento si applica a chiunque — nell'Unione Europea o operando nel suo mercato — sviluppi, distribuisca o utilizzi sistemi di intelligenza artificiale. La parola chiave è "utilizzi": non devi aver costruito il modello, basta usarlo. Se nella tua azienda c'è anche solo un chatbot sul sito, un sistema di raccomandazione prodotti, uno strumento di screening CV, un modello che classifica email commerciali, un assistente generativo usato per produrre contenuti o analizzare dati, rientri nel perimetro.

Il secondo errore è pensare che "tanto lo usiamo solo internamente, non riguarda i clienti". Il regolamento distingue tra diversi tipi di obblighi, e alcuni si applicano anche agli usi interni. La supervisione umana, la gestione dei dati di training, la documentazione dei sistemi ad alto rischio non dipendono dal fatto che il sistema sia rivolto all'esterno: dipendono dalla categoria di rischio del sistema stesso.

L'azione pratica da fare entro questa settimana è stendere un elenco esaustivo di tutti gli strumenti AI utilizzati nella tua azienda. Non solo quelli che tu hai introdotto consapevolmente, ma anche quelli che sono arrivati dentro software già esistenti: il CRM che oggi ha un modulo AI, il gestionale che ora propone predizioni, la piattaforma di marketing automation che scrive i testi con un modello generativo. La sorpresa quasi sempre è che la lista è più lunga di quanto ci si aspetti.

Le categorie di rischio: come capire in quale rientri

L'AI Act classifica i sistemi in quattro categorie di rischio, e da questa classificazione discendono obblighi molto diversi.

Il rischio inaccettabile comprende gli usi vietati: social scoring di tipo governativo, sistemi manipolativi che sfruttano vulnerabilità di utenti fragili, riconoscimento biometrico in tempo reale in spazi pubblici per scopi di law enforcement (con eccezioni). Se sei una PMI italiana normale, è molto improbabile che tu rientri in questa categoria. Se però usi sistemi che classificano le persone in modo automatizzato per prendere decisioni che le riguardano, vale la pena verificare con attenzione.

Il rischio alto è la categoria che genera più obblighi concreti e include molti casi rilevanti per le PMI. Ci rientrano i sistemi AI usati per la selezione e gestione del personale (screening CV, valutazione di candidati, gestione di performance), i sistemi di scoring creditizio, i sistemi usati nell'istruzione per valutare studenti, i sistemi usati in infrastrutture critiche, alcune applicazioni in sanità, sistemi di identificazione biometrica non proibiti. Se ti sembra di non rientrare, verifica comunque: lo screening CV automatizzato è molto più diffuso di quanto si creda, a volte nascosto dentro suite HR più ampie.

Il rischio limitato riguarda sistemi con obblighi di trasparenza: chatbot che interagiscono con utenti, sistemi che generano o manipolano contenuti (deepfake, immagini sintetiche). L'obbligo principale è informare chiaramente l'utente che sta interagendo con un'AI o che un contenuto è stato generato artificialmente.

Il rischio minimo copre la stragrande maggioranza degli usi non critici: filtri antispam, AI nei videogiochi, assistenti per suggerimenti non decisionali. Nessun obbligo specifico aggiuntivo oltre al rispetto della normativa generale.

Il consiglio operativo è, per ogni strumento AI della tua lista, scrivere esplicitamente la categoria di rischio a cui appartiene, e mettere quella classificazione in un documento che potrai mostrare in caso di controllo. Questo semplice esercizio è già metà del lavoro di compliance per una PMI.

Gli obblighi concreti per una PMI italiana

Gli obblighi variano per ruolo (sviluppatore, importatore, utilizzatore) e per categoria di rischio. Per una PMI che utilizza sistemi AI sviluppati da altri, gli obblighi principali si riducono a un insieme abbastanza gestibile.

Trasparenza verso gli utenti. Se usi un chatbot, devi informare chi interagisce che sta parlando con un sistema AI. Se produci contenuti generati da AI (testi, immagini, video), devi etichettarli come tali. È una modifica a banner, disclaimer e template che si può fare in poche settimane se la priorità è chiara.

Supervisione umana sui sistemi ad alto rischio. Significa avere una persona — con competenze adeguate — che può fermare, correggere o sovrascrivere le decisioni del sistema. Non è una supervisione teorica: deve esserci un processo definito su come interviene e quando.

Documentazione. Devi poter mostrare cosa fa il sistema, con quali dati è stato addestrato (se lo sai), quali sono i rischi residui, che controlli hai messo in atto. Non sono necessariamente documenti lunghissimi, ma devono esistere.

Gestione dei dati. Se i dati che dai in pasto al sistema includono informazioni personali, valgono tutte le regole del GDPR in aggiunta, e la combinazione dei due regolamenti può richiedere aggiustamenti: basi giuridiche, informative, minimizzazione, periodi di conservazione.

Segnalazione di incidenti per i sistemi ad alto rischio: se il sistema produce un danno serio o un malfunzionamento significativo, vanno fatte comunicazioni alle autorità competenti.

Il consiglio pratico è di non affrontare tutto insieme. Parti dalla trasparenza (è la più visibile e la più sanzionabile per primi), poi passa alla documentazione dei sistemi che hai classificato "ad alto rischio", poi consolida la parte di supervisione umana e processi.

Cosa fare nei prossimi 4 mesi: un piano realistico

Se leggi questo articolo in aprile, ecco un piano realistico diviso mese per mese.

Aprile — mappatura e classificazione. Entro fine aprile devi avere: (1) la lista completa dei sistemi AI in uso, (2) la classificazione per ogni sistema nelle quattro categorie di rischio, (3) una prima identificazione dei gap rispetto agli obblighi applicabili. Non serve essere perfetti: serve avere una base di lavoro.

Maggio — interventi sulla trasparenza. Aggiungi dove manca i disclaimer su chatbot, etichette sui contenuti generati da AI, informative aggiornate nella privacy policy. È il lavoro più veloce da fare e produce i risultati più visibili in caso di ispezione.

Giugno — documentazione e processi. Scrivi i documenti base per i sistemi classificati "ad alto rischio": descrizione, scopo, dati usati, controlli, rischi residui, processo di supervisione umana. Se hai più sistemi, inizia dal più critico. Definisci anche i ruoli interni: chi è responsabile, chi monitora, chi interviene in caso di incidente.

Luglio — verifica e messa a punto. Fai un test interno di conformità: prendi il tuo elenco di obblighi e verifica punto per punto se ci sei. Le cose che mancano, mettile in priorità massima. Il 2 agosto devi essere almeno nella condizione di "compliance ragionevole", cioè capace di dimostrare a un'autorità che hai affrontato il tema con metodo anche se non hai ancora tutto perfetto.

Un'osservazione importante: non serve arrivare al 2 agosto con la compliance al 100%. Serve arrivarci con un percorso documentato e ragionevole. Le autorità sanzionano soprattutto l'assenza di sforzo, non l'imperfezione.

Gli errori da evitare nella corsa alla compliance

Ci sono quattro errori ricorrenti da cui conviene tenersi alla larga.

Il primo è affidarsi a una "consulenza compliance" generica senza verificare le competenze specifiche. L'AI Act è una materia nuova, molti consulenti si stanno riposizionando velocemente. Chiedi esempi concreti di lavoro già fatto, fatti spiegare come distinguono un sistema ad alto rischio da uno limitato, verifica che conoscano la Legge 132/2025 che in Italia integra l'AI Act.

Il secondo è confondere AI Act e GDPR. Sono due regolamenti complementari, non alternativi. Essere compliant GDPR non ti rende compliant AI Act, e viceversa. Servono entrambi i lavori, con documenti distinti ma coerenti tra loro.

Il terzo è cercare di fare tutto internamente senza alcuna competenza esterna. Anche la PMI più autonoma può avere bisogno di una validazione esterna almeno sul punto critico — la classificazione del rischio — per evitare di interpretare male la norma. Un'ora di consulenza mirata vale più di cento ore di lettura del testo.

Il quarto è sottovalutare la componente formativa. Il regolamento prevede che chi usa sistemi AI nel contesto lavorativo abbia un livello di alfabetizzazione adeguato. Tradotto: una formazione minima per tutti i dipendenti che interagiscono con sistemi AI. Non è un obbligo tecnicamente sanzionabile da solo, ma è parte della compliance complessiva, e diventa molto visibile se arriva un controllo.

Conclusione

L'AI Act non è il regolamento più complesso mai scritto, ma è sicuramente il primo regolamento orizzontale sull'intelligenza artificiale che imponga obblighi operativi a chiunque la usi. Per una PMI italiana il lavoro da fare è gestibile, a patto di non lasciarlo agli ultimi giorni. Chi parte ad aprile con una mappatura ragionata e lavora con metodo nei mesi successivi arriva al 2 agosto in condizione di compliance ragionevole, senza stress e senza spese emergenziali.

Il passo concreto per questa settimana è uno solo: scrivi l'elenco dei sistemi AI in uso nella tua azienda. Non serve ancora sapere come classificarli, non serve ancora aver studiato il regolamento nel dettaglio. Serve avere l'elenco. Quello è il documento da cui parte tutto il resto, ed è l'unico che nessun consulente può fare al posto tuo.

Le domande più comuni

Quando entra in vigore l'AI Act per le aziende italiane?

L'AI Act europeo è in vigore per tappe. La data più rilevante per la maggior parte delle aziende è il 2 agosto 2026, quando diventano pienamente applicabili gli obblighi per i sistemi AI ad alto rischio e per i fornitori di modelli general-purpose. Alcune disposizioni (divieti assoluti su pratiche manipolative) sono già operative da febbraio 2025. Le sanzioni cominciano a scattare in parallelo all'entrata in vigore di ciascuna sezione.

Quali sanzioni prevede l'AI Act in caso di non conformità?

Le sanzioni massime arrivano fino a 35 milioni di euro o al 7% del fatturato annuo (si applica la cifra maggiore) per le violazioni più gravi, come l'uso di sistemi AI vietati. Per non conformità meno gravi si scende a 15 milioni o 3% del fatturato, e a 7,5 milioni o 1% per informazioni scorrette alle autorità. Le PMI e startup ottengono sanzioni proporzionalmente ridotte, ma non immuni.

Come si capisce se un'azienda deve adeguarsi all'AI Act?

Se usi sistemi AI in azienda, sei coinvolto. La domanda è in quale ruolo: fornitore (chi sviluppa o commercializza il sistema), deployer (chi lo usa internamente), importatore o distributore. I deployer, cioè la maggior parte delle PMI, hanno obblighi più leggeri ma reali, soprattutto per sistemi ad alto rischio. Il primo passo operativo è fare l'inventario dei sistemi AI usati e classificarli per livello di rischio.

Cosa significa "sistema AI ad alto rischio" nell'AI Act?

Sono sistemi utilizzati in settori o funzioni critiche elencate nell'Allegato III del regolamento: selezione del personale, valutazione creditizia, accesso a servizi essenziali, gestione di infrastrutture critiche, dispositivi medici, istruzione, forze dell'ordine. Non è il modello AI in sé a essere "ad alto rischio", è l'uso che se ne fa. Lo stesso LLM può essere a basso rischio se usato per classificare email e ad alto rischio se usato per filtrare candidature.

Quanto costa adeguarsi all'AI Act per una PMI?

Per una PMI che usa AI solo per casi a basso rischio, l'adeguamento si può fare con costi contenuti: qualche settimana di consulenza legale e organizzativa, aggiornamento delle informative privacy, documentazione interna. Stima indicativa: 2.000-10.000 euro. Se l'azienda usa sistemi ad alto rischio, i costi salgono in modo significativo (audit, documentazione tecnica, sistemi di monitoraggio) e possono superare i 50.000 euro nel primo anno. Il range è ampio perché dipende dal perimetro reale.

Chi è responsabile dell'adeguamento all'AI Act in azienda?

La responsabilità finale è del legale rappresentante, ma l'operatività va assegnata a una figura interna che faccia da punto di contatto. Nelle PMI tipicamente è lo stesso imprenditore o un responsabile IT con supporto legale esterno. Nelle aziende più grandi può essere un AI Officer dedicato. L'importante è che qualcuno abbia il mandato formale di mantenere l'inventario dei sistemi AI aggiornato e di coordinare con DPO e legale.